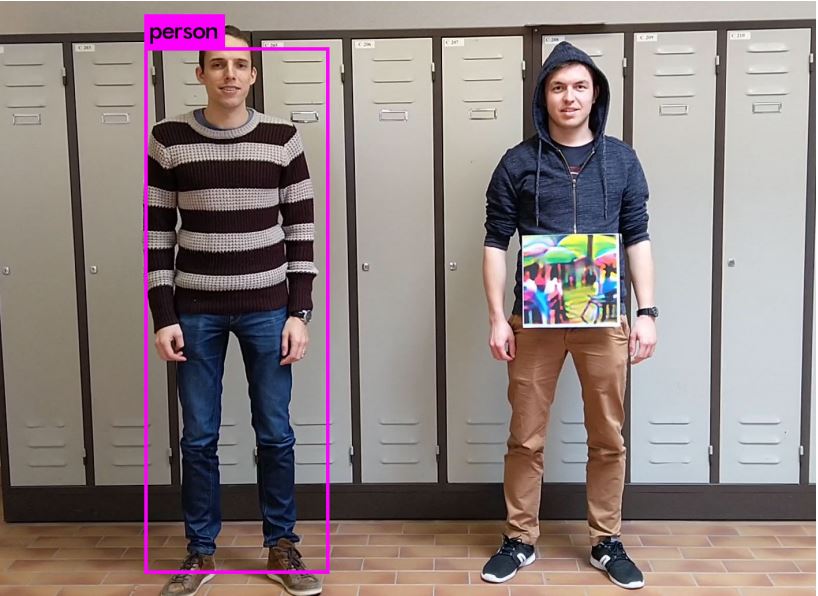

Des scientifiques ont réussi à déjouer une intelligence artificielle spécialisée dans l'identification de personnes en utilisant un motif coloré.

Pour cela, ils ont imprimé le motif coloré puis ont demandé à des personnes de le porter à leur cou ou de le tenir entre les mains. Chaque personne présentant le motif à la caméra devenait alors pratiquement invisible pour la machine.

Une découverte belge

La recherche a été menée par des étudiants belges de l'Université de Louvain. Bien évidemment, cette astuce ne marche que sur l'algorithme développé pour l'expérience. Néanmoins, les chercheurs estiment qu'il sera possible dans le futur d'utiliser la technique afin de créer des vêtements. Ceux qui les portent deviendraient alors invisibles aux yeux d'une caméra de surveillance connectée.

Un phénomène connu de l'intelligence artificielle

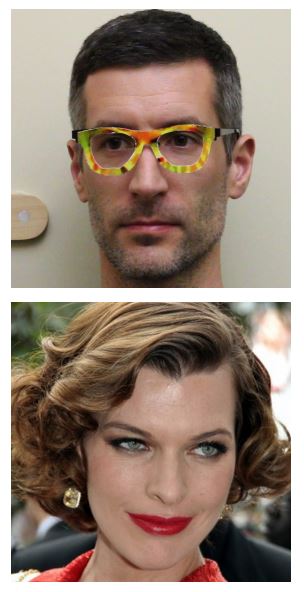

Même s'il est surprenant, le phénomène n'est pas nouveau. Il a même un nom : adversarial example. Les adversarial examples sont des données spécifiquement créées pour duper une intelligence artificielle. Pour des humains, on parlerait d'illusions d'optique. Et ces motifs peuvent être imprimés sur de nombreux supports : objets imprimés en 3D, autocollants, etc. Par exemple, un scientifique avait précédemment réussi à faire passer n'importe qui pour l'actrice Milla Jovovich. Il lui suffisait de faire porter à la personne des lunettes dont la monture arborait un motif spécial.

Le danger de ce phénomène

Les adversarial examples peuvent devenir un outil de défense des libertés. Ils pourraient notamment éviter les arrestations arbitraires dans des pays totalitaires. Mais ils peuvent également poser problème. En effet, certains pourraient s'en servir pour rendre un panneau de signalisation invisible aux yeux d'une voiture autonome. D'autres pourraient également l'utiliser pour fausser les résultats d'un examen médical réalisé par une intelligence artificielle. On peut également penser à des cambrioleurs.

Néanmoins, pour le cas des étudiants belges, les risques liés à leur trouvaille restent minimes : leur astuce ne fonctionne pas sur d'autres algorithmes. Par contre, ce fait met en lumière un autre phénomène : la prolifération des acteurs qui travaillent sur l'IA. Et comme chaque entreprise dispose de son propre système d'intelligence artificielle, il faudra du temps pour voir apparaître un système qui les dupe tous.

- Partager l'article :