L'intelligence artificielle est souvent présentée comme un dispositif révolutionnaire permettant, entre autres de donner une personnalité à certains robots. Pourtant, certaines personnes s'imaginent déjà une société contrôlée par ces intelligences artificielles. Mythe ou réalité ?

Un rêve qui n'est pas nouveau

La véritable naissance de l'intelligence artificielle est souvent associée à la « Computing Machinery and Intelligence » d'Alan Turing. Grâce à son test de Turing, l'homme voulait pouvoir définir si une machine était consciente ou pas. Mais à ce jour, il n'a jamais été possible de le réaliser, définir l'intelligence étant assez difficile à définir. Quelques années plus tard dans le très prestigieux New York Times parle du Perceptron que le journal définit comme un « embryon d'un calculateur électronique que [la Marine américaine] attend et sera en mesure de marcher, parler, voir, écrire, de reproduire lui-même et être conscient de son existence. »

Pourtant, plus d'un demi-siècle plus tard, les progrès, bien que prodigieux, sont encore loin de ce qu'espéraient déjà les chercheurs de l'époque.

Une inquiétude grandissante

Cela n'empêche pas d'éminents scientifiques d'être inquiets à commencer par Stephen Hawking. Dans une lettre ouverte signée par plusieurs éminents scientifiques, le physicien explique :

[blockquote style= »1″]On peut imaginer une telle technologie déjouer les marchés financiers, dépasser les chercheurs humains, les dirigeants humains et développer des armes que nous ne pouvons même pas comprendre. Alors que l'impact à court terme de l'IA dépend de qui la contrôle, celui à long terme dépend de savoir si elle peut être contrôlée par quiconque. Donc, face à de possibles avantages et des risques incalculables, les experts devraient sûrement se trouver en train de faire tout leur possible pour nous garantir les meilleures conséquences, non ? Faux. Si une civilisation extraterrestre supérieure nous envoie un jour un message disant : “Nous arriverons dans quelques décennies”, devrions-nous répondre simplement, “OK, appelez-nous quand vous arrivez ici, nous allons laisser les lumières allumées” ? Probablement pas. Et pourtant, c'est plus ou moins ce qui se passe avec l'IA.[/blockquote]

Elon Musk lui même semble s'inquiéter de l'apparition d'une intelligence artificielle dangereuse. Le patron de Tesla a donné pas moins de 10 millions d'euros à un institut pour créer des intelligences artificielles « amicales ». Des éminences dans le domaine de la technologie n'hésitent pas non plus à prédire des scénarios catastrophes. Steve Wozniak de Apple imagine un futur effrayant ou les humains pourraient être transformés en « animaux domestiques » et « écrasés comme des fourmis ». Vous l'aurez compris, rien de bien réjouissant.

Cette inquiétude est-elle justifiée ?

Encore une fois, les deux camps ont des arguments valables. Si les alarmistes parlent de cataclysme humanitaire, c'est avant tout pour faire un électrochoc dans la tête de ceux qui travaillent à une intelligence artificielle toujours plus réaliste. Les dangers existent comme l'explique Michel Nachez, cyberanthropologue, dans une interview accordée à nos confrères de Rue 89 :

[blockquote style= »1″]On met au point des choses, on les teste, puis quand on les met en réel, on se rend compte qu'il y a des effets secondaires indésirables. Il y a des domaines où ça peut être tellement dangereux qu'on doit être absolument sûr avant d'avancer. Je pense qu'avant d'envoyer des robots connectés en réseau au sein de la population, il faudrait s'assurer qu'ils sont sécurisés, qu'ils ne sont pas « hackables », qu'ils aient un réseau interne, mais pas ouvert sur Internet… Quand on fait de la recherche sur l'intelligence artificielle, on doit se poser la question de : « Qu'est-ce qui se passe… si elle émerge ? » Et si elle émerge, de ne pas la mettre dans un réseau public dont elle connaîtra les failles, la tester suffisamment pour savoir de quelle nature elle est. C'est possible, et nous avons des gens très doués pour faire ce travail. Est-ce que ça sera fait ? Le problème est que, quand on a en face des sociétés privées comme Google, elles sont incontrôlables. [/blockquote]

Si elle peut être dangereuse, l'intelligence artificielle a déjà changé nos vies et pourrait continuer, dans le bon sens du terme. Des ordinateurs plus performants, une immersion vidéoludique toujours plus réaliste, des aides médicales, ou encore la reconnaissance faciale sont autant de facettes positives de l'intelligence artificielle.

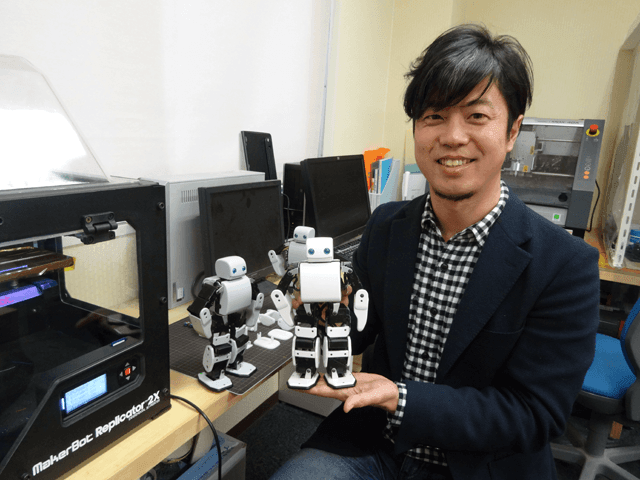

Et qu'en est-il de l‘éducation ou encore du service aux personnes âgées ? L'intelligence artificielle peut également être un remède à la solitude. À l'image de PLEN 2, nombre de petits robots ont pour fonction d'être un véritable compagnon de route pour tous ses possesseurs.

Conclusion

Pour résumer, l'intelligence artificielle, telle qu'elle est aujourd'hui n'est pas dangereuse mais pourrait le devenir. Si l'innovation progresse rapidement, elle est encore loin d'être capable de reproduire une véritable conscience dans un corps construit de toute pièce. Reste que pour les années à venir, il faudra être prudent et réfléchir à une question : Quelle place donner à la machine au milieu des Hommes ?

- Partager l'article :